这是我见过讲解最详细最通俗易懂的决策树(一)

- 基本流程

- 如何划分选择

- 总结

基本流程

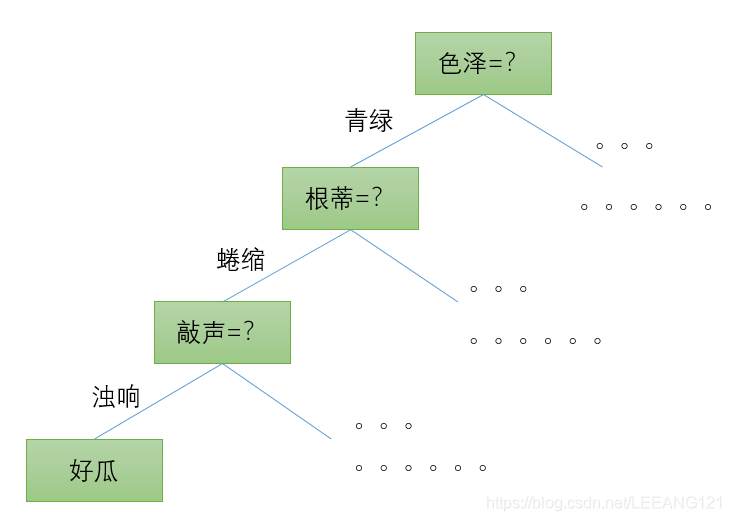

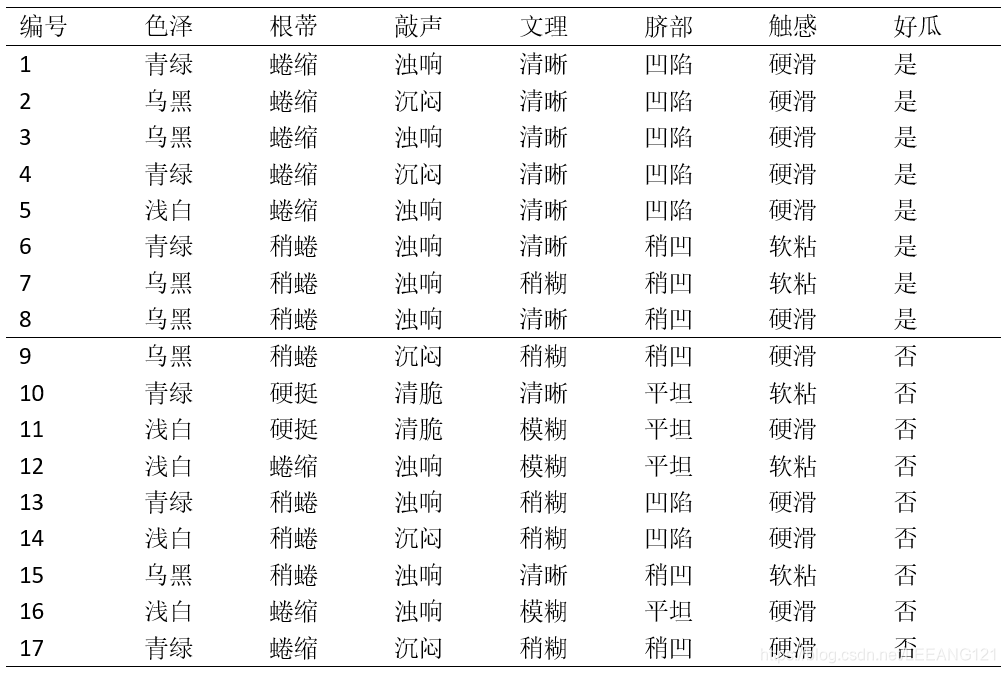

我们在这篇文章没有公式,我们只谈决策树里面跟大家简单的介绍了决策树是个啥东西。今天我们将深入的介绍一下决策树。 首先决策树是一类常见的机器学习方法,以二分类任务为例。我们希望从给定的数据集中学习一个模型用来对新的示例进行分类。 如下图所示:

如何划分选择

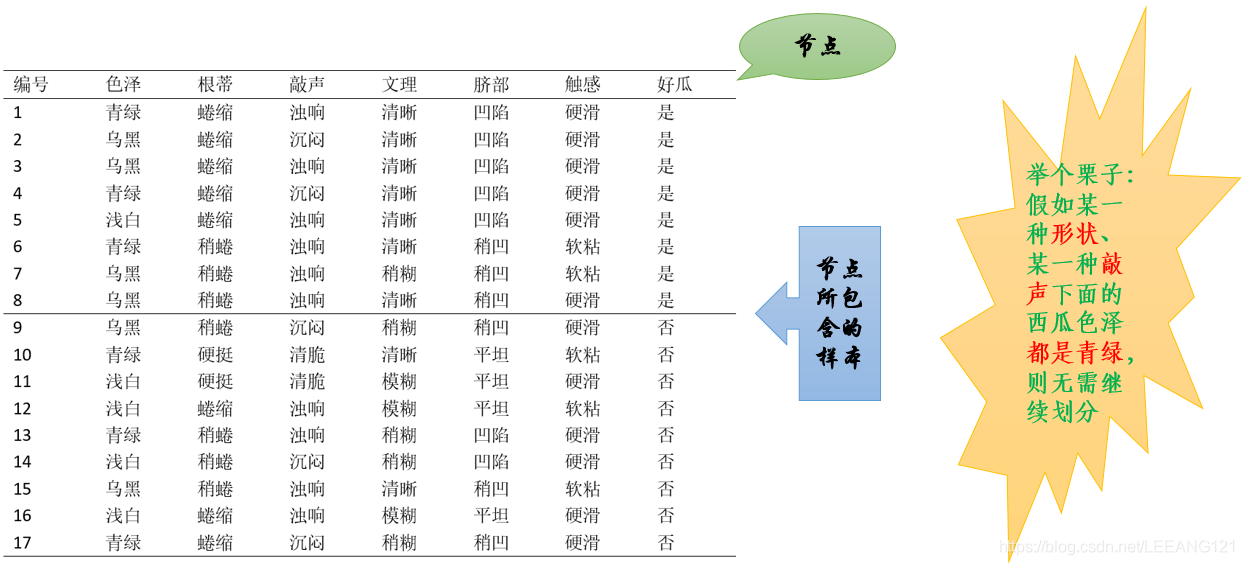

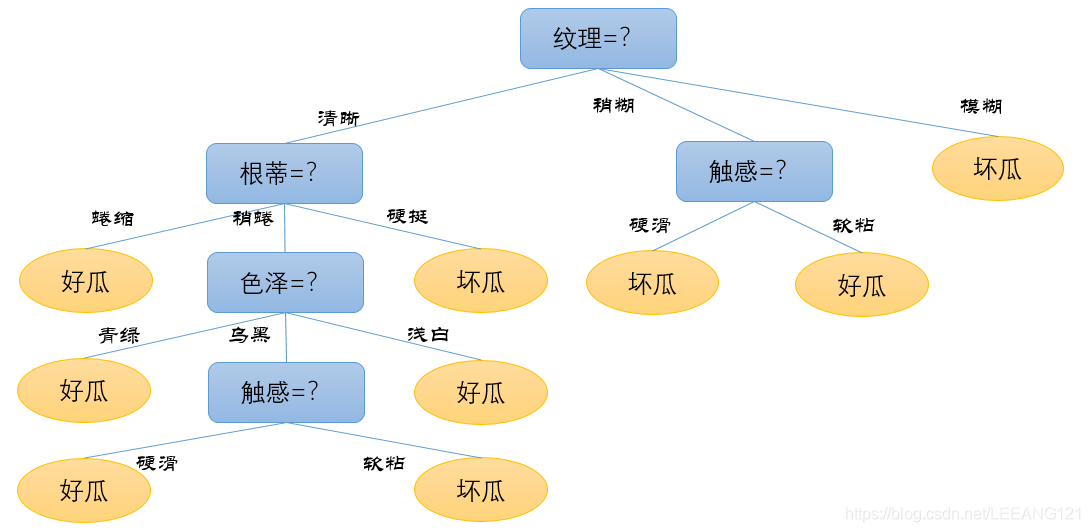

从开篇第一幅图及上面的后续介绍,我们可以发现,决策过程其实就是不断划分的过程。我们是希望决策树的分支结点所包含的样本尽可能属于同一类别,即结点的’纯度‘会越来越高。 信息增益 大家看到这个名词的时候不用慌张,其实仔细想一想,仅从字面意思也不难理解,信息增益的意思就是指某条信息对整体的增幅情况。简单可以理解为该信息的 权重。 在研究权重之前,我们先回到上面那个纯度的问题上,通常我们会用‘信息熵’来度量样本集合的纯度,熵这个词大家还有没有印象?如果忘记了可以参考我的一篇博文啥也不会,照样看懂交叉熵损失函数,这里有介绍熵的概念及公式。 当然这里我们也会简单进行一下说明:假定当前样本集合D 中的第k 类样本所占比例为p k(k=1,2,3,…|y|,则D 的信息熵为

现在我们来计算每个属性的信息增益。 我们以属性’色泽‘为例,它有三个可能的取值(青绿、乌黑、浅白)。在我们利用这个色泽属性对D进行划分的时候,可以得到三个子集,我们把这三个子集分别记为: D1(色泽=青绿) D2(色泽=乌黑) D3(色泽=浅白)

现在我们来计算每个属性的信息增益。 我们以属性’色泽‘为例,它有三个可能的取值(青绿、乌黑、浅白)。在我们利用这个色泽属性对D进行划分的时候,可以得到三个子集,我们把这三个子集分别记为: D1(色泽=青绿) D2(色泽=乌黑) D3(色泽=浅白)

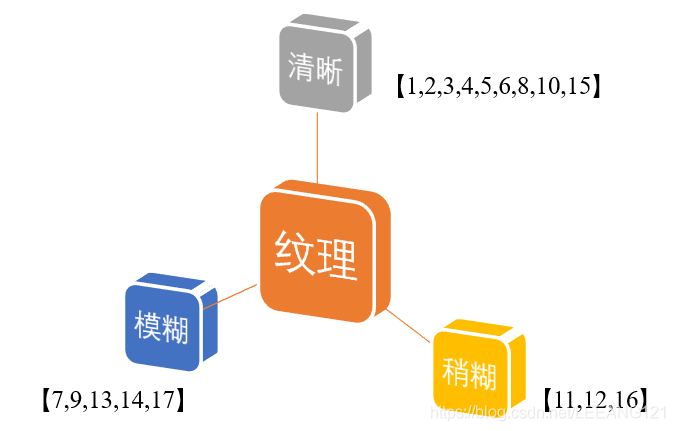

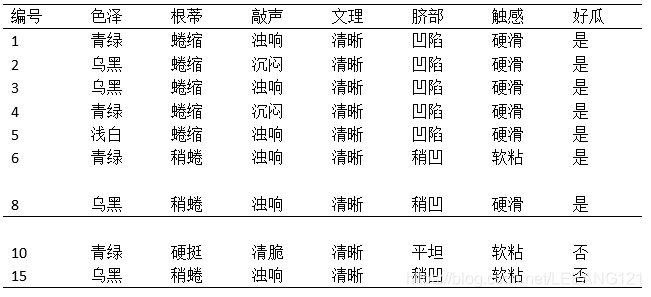

很明显,属性’纹理‘的信息增益最大,于是它被选择用来划分属性。 下图显示了基于‘纹理’对根节点进行划分的结果,各分支结点所包含的样例子集显示在结点中。

很明显,属性’纹理‘的信息增益最大,于是它被选择用来划分属性。 下图显示了基于‘纹理’对根节点进行划分的结果,各分支结点所包含的样例子集显示在结点中。

总结

以上就是决策树以及如何划分结点的详细说明,下一节我们会重点介绍: 增益率 基尼指数 剪枝处理 预剪枝 后剪枝 以上所有内容均来自周志华的《机器学习》,以及一点个人的心得。 这里还要感谢郭老师的大力支持。